Temidden van de groeiende rivaliteit in de kunstmatige intelligentie (AI) industrie, passen sommige bedrijven hun benadering van de reikwijdte van AI-toepassingen aan. Vorig jaar schrapte OpenAI bepaalde voorwaarden uit zijn beleid voordat het een deal met het Pentagon aankondigde. Nu is het de beurt aan Google, dat zijn “principes voor AI” heeft bijgewerkt.

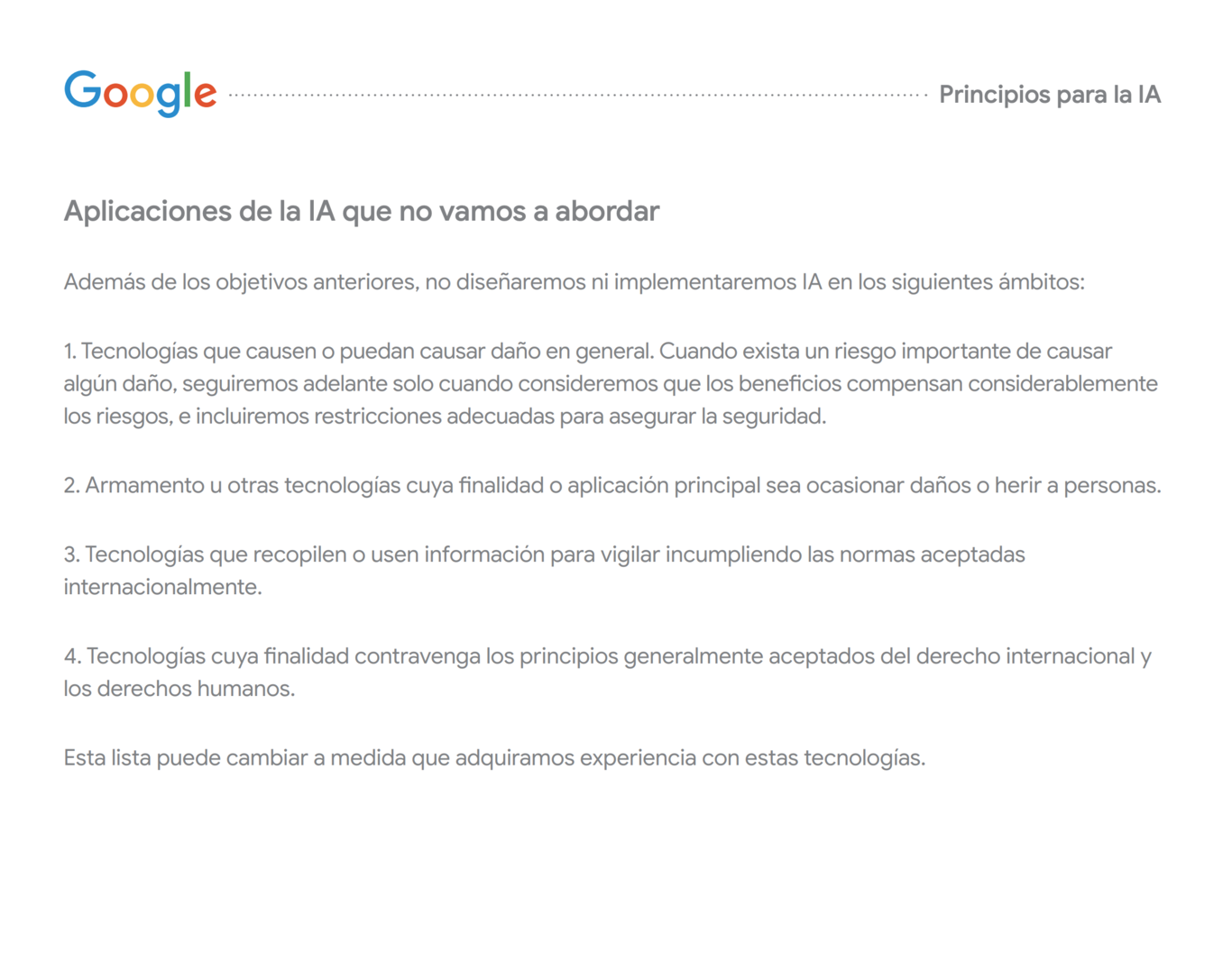

De firma uit Mountain View heeft het document bijna volledig herwerkt, maar wat het meest opvalt is de afwezigheid van de categorie “AI-toepassingen die we niet zullen behandelen”. Zoals de naam al suggereerde, groepeerde het verschillende specifieke gebieden waarin AI-oplossingen niet zouden worden ontworpen of geïmplementeerd om de verantwoorde ontwikkeling van AI te behouden.

Google, kunstmatige intelligentie en wapens

Zoals we in de schermafbeelding kunnen zien, bevatte de oorspronkelijke lijst als eerste punt “technologieën die schade veroorzaken of kunnen veroorzaken in het algemeen. Als er een aanzienlijk risico is op het veroorzaken van schade, zullen we alleen doorgaan als we van mening zijn dat de voordelen aanzienlijk opwegen tegen de risico’s, en we zullen passende beperkingen opnemen om de veiligheid te waarborgen.

De volgende punten zijn “wapens of andere technologieën waarvan het hoofddoel of de toepassing is om schade of letsel toe te brengen aan personen, technologieën die informatie verzamelen of gebruiken voor bewaking in strijd met internationaal aanvaarde normen, technologieën waarvan het doel in strijd is met algemeen aanvaarde beginselen van internationaal recht en mensenrechten”.

Bloomberg, een van de eerste media die de wijziging opmerkte, vroeg Google om commentaar. Het bedrijf reageerde met een blogpost, ondertekend door James Manyika, SVP van Google, en Demis Hassabis, die het Google DeepMind AI-lab leidt, die de verantwoorde ontwikkeling van AI in de democratie bespreekt en verwijst naar de bijgewerkte principespagina.

“We erkennen hoe snel de onderliggende technologie en het debat rond de vooruitgang, implementatie en het gebruik van AI zullen blijven evolueren, en we zullen onze aanpak blijven aanpassen en verfijnen terwijl we allemaal in de loop van de tijd leren”, aldus het bedrijf. Opgemerkt moet worden dat Google geen nieuwe defensiecontracten bekend heeft gemaakt.

In het verleden werkte het door Sundar Pichai-geleide bedrijf samen met het Pentagon aan het Maven-project, waarbij AI werd gebruikt om gegevens van verschillende bronnen (voornamelijk drones) te verwerken, potentiële doelwitten in oorlogsgebieden te identificeren en meer. Google besloot zijn samenwerkingscontract met de Amerikaanse overheid niet te verlengen nadat zijn eigen werknemers protesteerden.